Notice

Recent Posts

Recent Comments

Link

클라우드 기억 저장소

[반도체] 왜 HBM이 인공지능의 ‘목마른 우물’이 되었을까? 본문

📋 핵심 내용 먼저 요약

- 인공지능 모델은 매개변수(모델의 내부 가중치) 확대뿐 아니라 토큰(인공지능이 처리하는 최소 텍스트 단위) 처리량을 급격히 늘려 왔고, 토큰이 2배 늘면 필요한 고대역폭 메모리 용량은 약 4배로 뛰어 메모리 수요를 비선형으로 키웠음.

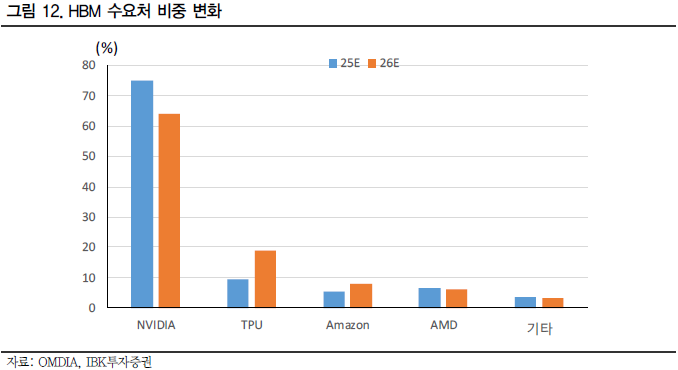

- 2025년에는 미국의 엔비디아가 고대역폭 메모리 물량의 약 70퍼센트 이상을, 2026년에도 가장 큰 축을 담당하되 구글의 인공지능 가속기(테이퍼 유닛, Tensor Processing Unit) 등 주문형 집적회로(Application Specific Integrated Circuit)의 비중이 뚜렷이 커질 전망임.

- 공급 측면에서 2025년 고대역폭 메모리 출하는 대한민국의 에스케이하이닉스가 약 60퍼센트로 절대 우위이나, 2026년에는 삼성전자의 진입 확대로 점유율 구도가 과점으로 재편될 가능성이 큼.

- 2027년 고대역폭 메모리 매출은 동종 메모리(디램, Dynamic Random Access Memory) 시장 매출의 과반(약 55퍼센트)을 차지할 것으로 추정되어 메모리 산업 가치사슬의 중심축이 고대역폭 메모리로 이동 중임.

- ‘컴퓨트 익스프레스 링크(Compute Express Link)’는 중앙처리장치·그래픽 처리 장치·가속기와 메모리를 고속·일관성 있게 잇는 차세대 인터커넥트 표준으로 2026년부터 상업적 도입이 본격화될 가능성이 있으나, 비용·호환성·생태계 미성숙이 제약 요인으로 남아 있음 .

- 2018년의 디램 가격 급락은 고객사의 과잉확보와 주문취소가 촉발한 수요 붕괴가 원인이었으나, 현재는 생산능력 확장이 제한적이고 인공지능 수요가 구조적으로 확대되어 같은 궤적을 밟을 가능성은 낮다고 판단됨.

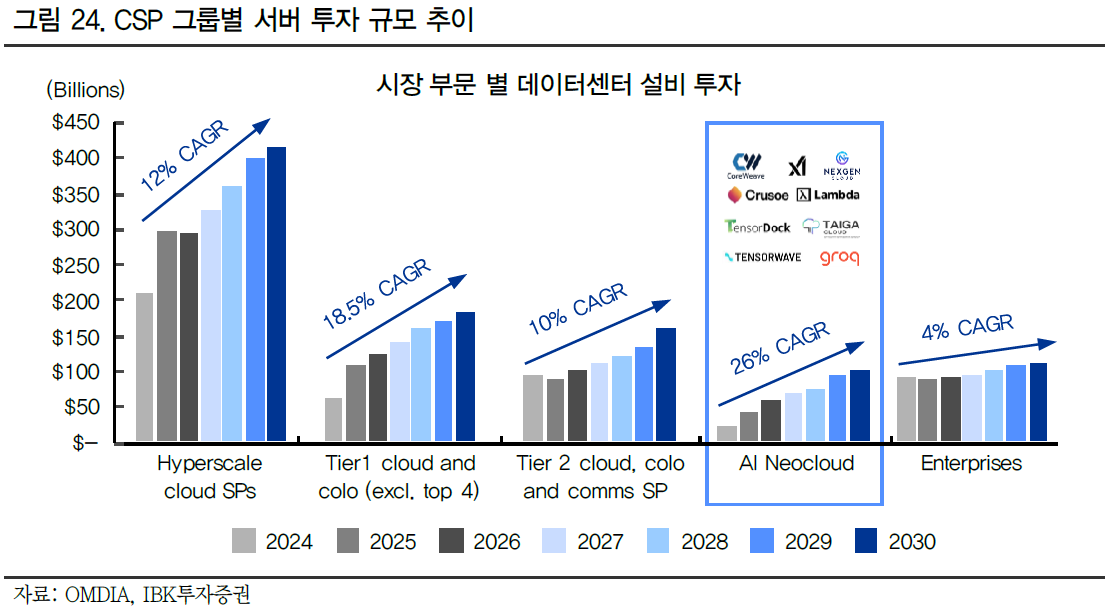

- 클라우드 사업자 가운데 초대형 사업자가 투자를 주도하는 가운데, 인공지능·머신러닝에 특화된 ‘네오 클라우드(Neo-cloud)’의 투자 성장률이 가장 높아 신흥 수요원으로 부상 중임.

- 결론적으로, 인공지능의 ‘긴 문맥(대화·문서·멀티모달 입력) 처리’는 메모리 집약도를 키우며, 고대역폭 메모리는 2026~2027년 산업·자본시장 재평가의 핵심 축으로 작동할 가능성이 큼 .

🚀 사건의 핵심은?

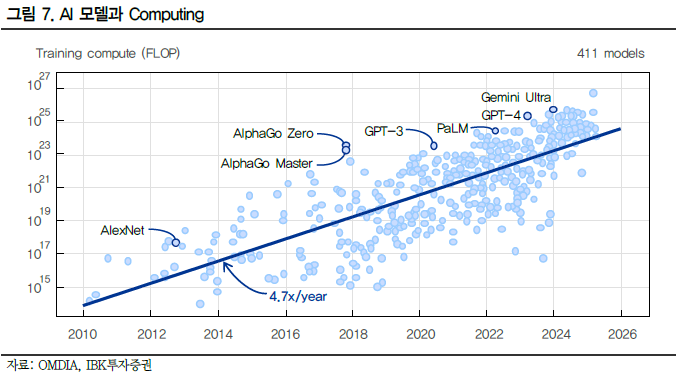

- 인공지능 모델은 매년 성능이 가파르게 상승했고, 2010년부터 2026년까지 계산량은 연평균 약 4.7배 증가하여 초거대 모델이 일상화됨.

- 추론(서비스 단계)에서 중요한 지연시간(응답 지연)과 토큰 창(한 번에 읽고 기억하는 텍스트 길이)이 커질수록, 연산장치가 아니라 메모리 대역폭이 병목이 되어 고대역폭 메모리 수요가 급증함.

- 최신 대형 언어 모델들은 수십만~수백만 토큰의 문맥 창을 제공하며, 토큰 증가가 곧 캐시 메모리·고대역폭 메모리 소비의 급증으로 이어짐.

- 이 변화는 훈련(데이터 학습) 중심에서 추론(실사용) 비중 확대, 그리고 ‘행동하는 인공지능(Agentic Artificial Intelligence)’로의 진화와 맞물려 있음.

- 결과적으로 ‘더 좋은 인공지능일수록 더 많은 고대역폭 메모리’라는 등식이 성립했고, 이는 2024~2027년 수요 추세에서도 확인됨.

💰 누가 얼마나 수혜인가?

- 2025년 고대역폭 메모리 사용처 중 미국의 엔비디아 비중이 약 75퍼센트로 추정되며, 구글 테이퍼 유닛이 약 9.5퍼센트, 미국의 어드밴스드 마이크로 디바이시스와 미국의 아마존이 뒤따름.

- 2026년에는 주문형 집적회로 축이 확대되어 구글 테이퍼 유닛은 약 19퍼센트로 비중이 상승할 것으로 예상됨.

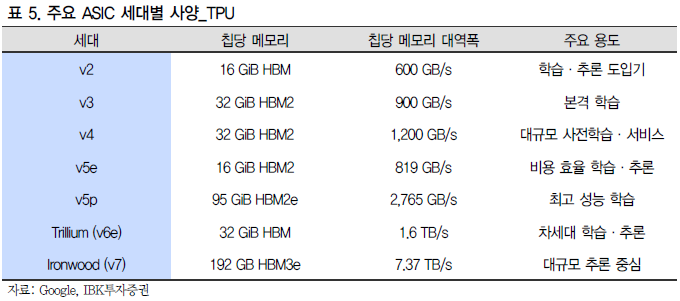

- 구글 테이퍼 유닛은 세대가 진화할수록 칩당 고대역폭 메모리 용량이 8기가바이트에서 192기가바이트로 커짐(세대별: v1 → v7).

- 아마존의 인공지능 학습용 ‘트레이니엄(Trainium)’도 세대가 오를수록 칩당 고대역폭 메모리 탑재량이 증가하며, 추론용 ‘인퍼렌티아(Inferentia)’는 디더램에서 고대역폭 메모리로 전환하여 대규모 언어 모델 추론을 겨냥함.

- 2026년 고대역폭 메모리 시장 내 공급은 에스케이하이닉스가 상대 우위이나, 삼성전자·마이크론이 엔비디아 납품 비중을 늘리며 다극화될 조짐임.

- 2027년에는 고대역폭 메모리 매출이 동종 메모리 대비 압도적인 성장세를 보이며 업체 이익 개선을 견인할 가능성이 큼.

🌐 구조 변화는?

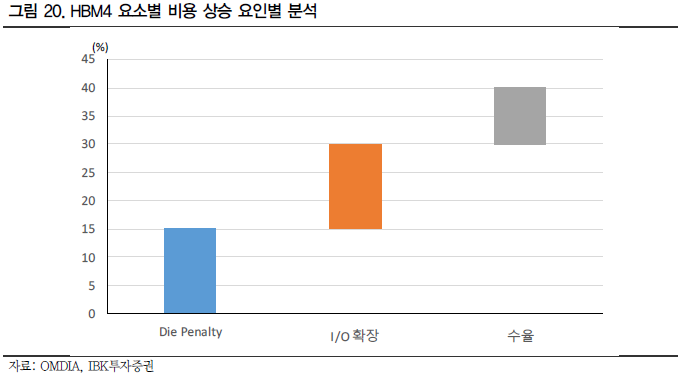

- 고대역폭 메모리는 세대가 오를수록 입출력 단자 수(입출력, I/O)·칩 적층 높이(층수)·베이스 다이(로직/메모리 혼합)의 추가로 생산비가 상승해 ‘가격 프리미엄’이 구조적으로 붙음.

- 특히 HBM4(네 번째 세대 고대역폭 메모리)부터는 가격이 최소 35퍼센트 이상 높아져야 기존 수익성을 방어할 수 있을 만큼 원가 요인이 확대됨(다이 패널티·입출력 확대·수율 부담·베이스 다이 추가).

- 2026년 차세대 그래픽 처리 장치 ‘루빈 R100’은 HBM4를 채택할 전망이며, 고객 품질 승인이 출하량을 좌우할 핵심 변수로 남음.

- 이러한 비용·품질 구조는 고대역폭 메모리의 과잉 생산 가능성을 낮추고, 승인된 공급자 위주의 과점 구조를 공고히 함 .

⚖️ 절차·일정

- 2025년 하반기: 미국의 인텔 ‘그래나이트 래피즈’ 중앙처리장치가 ‘컴퓨트 익스프레스 링크 3.0’을 지원하고 일부 완제품 제조사에서 시험 적용 예정임.

- 2026년: 미국의 어드밴스드 마이크로 디바이시스 ‘투린’ 및 인텔 ‘제온’이 ‘컴퓨트 익스프레스 링크 3.0’에 대응하고 최초의 상업용 ‘풀링 준비’ 인프라가 등장할 전망임.

- 2027년: ‘컴퓨트 익스프레스 링크 3.1/3.2’가 스위치와 메모리 모듈에 채택되고, 하이퍼스케일러(초대형 클라우드 사업자)들이 네트워크 패브릭 수준에서 메모리 풀링을 적용할 가능성이 큼.

📈 투자 전략

- 스토리라인 핵심: “토큰 창 확대 → 지연시간 민감도 상승 → 메모리 대역폭이 병목 → 고대역폭 메모리 채택 확대 → 2026~2027년 매출·점유율 재편”이라는 선형 고리가 작동함 .

- 주기·사이클 관점: 2018년의 단일 ‘서버 업사이클’ 과열과 달리, 현재는 인공지능 추론·멀티모달·장기 문맥 처리라는 구조적 수요가 다변화되어 사이클 둔화 충격이 분산됨.

- 바스켓(묶음) 접근: (a) 고대역폭 메모리 선도 공급자, (b) 엔비디아 중심의 고대역폭 메모리 수요 체인, (c) 주문형 집적회로 확장에서 이익 레버리지 받는 반도체 장비·소재를 단계적으로 편입함 .

- 모멘텀 트리거: (a) 고대역폭 메모리 신규 세대(예: 네 번째 세대) 고객 승인, (b) 초대형 모델의 문맥 창 상향 발표, (c) 초대형 클라우드 자본지출 가이던스 상향, (d) 네오 클라우드 대규모 발주 뉴스가 유의미 신호로 작동함 .

⚠️ 유의점/리스크

- 비용 리스크: 고대역폭 메모리의 다이 크기 확대·입출력 증가·적층 공정 심화로 원가가 구조적으로 상승해 가격 정상화 과정에서 수요 탄력성이 시험될 수 있음.

- 0 생태계 리스크: ‘컴퓨트 익스프레스 링크’의 상호운용성·스위치 생태계·피지컬 계층(예: PCI Express 6.0 요구) 미성숙이 초기 확산 속도를 제약할 수 있음.

- 수요 충격 리스크: 인공지능 서비스의 수익성(예: 월별 매출 가속)이 둔화되면 장비 확장 속도가 낮아질 수 있음.

- 과거 사이클 반복에 대한 경계: 2018년에는 고객 과잉확보·주문취소가 가격 급락을 유발했으나, 현재는 재고 수준이 낮아졌고 생산능력 확대가 제한적이라 같은 폭의 급락 가능성은 낮다고 판단함.

📌 관계도/표

- 수요 흐름(텍스트 화살표):

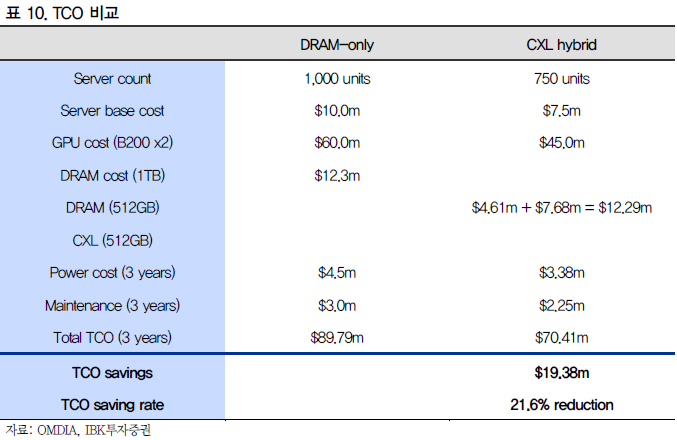

초거대 인공지능 모델 → 긴 문맥·멀티모달 입력 증가 → 지연시간 민감도 상승 → 메모리 대역폭 병목 → 고대역폭 메모리 채택 확대 → 공급자 과점 심화 . - 총소유비용(Total Cost of Ownership) 비교 요지:

디램만으로 구성한 인공지능 서버 1,000대 대비, ‘컴퓨트 익스프레스 링크 하이브리드’ 750대로 구성 시 3년 총비용이 약 21.6퍼센트 낮아짐(89.79백만 달러 → 70.41백만 달러).

📈 리스크 & 기회(시계열 프레이밍)

단기(1~3개월)

- 확인 포인트: 초대형 클라우드 사업자 자본지출 업데이트, 최신 모델의 문맥 창 상향 공지, 고대역폭 메모리 신규 세대 고객 승인 공시 .

확률: 60퍼센트 / 영향도: 보통. - 리스크: 고대역폭 메모리 단가 정상화(계약 조정) 뉴스로 단기 변동성 확대 가능 .

확률: 40퍼센트 / 영향도: 보통.

중기(6~12개월)

- 확인 포인트: 주문형 집적회로 비중 확대(구글 테이퍼 유닛·아마존 트레이니엄 세대 전환), ‘컴퓨트 익스프레스 링크 3.0’ 상업 배치 사례 증가 .

확률: 65퍼센트 / 영향도: 높음. - 기회: 2027년까지 고대역폭 메모리 매출 비중이 디램의 과반을 돌파하는 구조 변곡점이 확인되면 밸류에이션 재평가가 진행될 가능성 큼.

확률: 55퍼센트 / 영향도: 높음.

🧵 한 줄 코멘트

이번 변화는 ‘작은 빨대에서 넓은 빨대로 바꾼’ 음료처럼, 입구(대역폭)를 넓힌 쪽이 속도를 지배하므로 먼저 넓힌 기업이 더 많은 수익을 빨아들일 것임 .

출처 : IT 산업분석 - [IBKS In-Depth Report] AI는 메모리 먹는 하마 : 네이버페이 증권

'돈 불리기 > 산업보고서' 카테고리의 다른 글

| [조선] 왜 2026년 조선업은 ‘선가 소폭 조정’에도 주가가 버티고, 방산으로 리레이팅될까? (1) | 2025.10.29 |

|---|---|

| [조선] ‘LNG 운반선(↔보냉재)’ 사이클은 2028년 슬롯 완판과 함께 다시 가열될까? (1) | 2025.10.28 |

| [엔터] 왜 ‘향후 6개월’이 K-팝 대세 상승의 출발점일까? (0) | 2025.10.11 |

| [유틸리티] 희토류, 미래 산업을 건 줄다리기 (1) | 2025.09.14 |

| [전력/통신] AI 때문에 케이블 대란이다? LS가 갑자기 주목받는 이유 (6) | 2025.08.28 |